Mes clients me demandent régulièrement ce qu’est le référencement et à quoi sert le SEO.

Le SEO (Search Engine Optimization) c’est un ensemble de pratiques et de méthodes qui va permettre d’améliorer le référencement d’un site par les moteurs de recherches. On l’appelle aussi le référencement naturel. C’est-à-dire de faire remonter le site le plus haut possible sur les résultats de recherche en fonction de certaines « requêtes » : ce qu’un utilisateur va taper dans sa barre de recherche.

Ça, c’est la réponse courte. Maintenant, j’imagine que vous voulez en savoir un peu plus.

Un peu d’histoire sur les moteurs de recherche

Lorsque l’on parle de moteur de recherche, tout le monde pense au géant Google. Si c’est aujourd’hui le leader du marché pour les pays dits « occidentaux », c’est par contre loin d’être le premier moteur de recherche historiquement -et pas le seul sur le marché, au passage-.

Google s’est réellement « lancé » en 1998, avant lui, les précurseurs tels qu’Archi et Gopher étaient les pionniers en 1990 ; en même temps, finalement, que le début de l’Internet « grand public », avec la première page mise en ligne en août 1991. Ils n’étaient pas capables de reconnaître encore les fameux « mots-clés » et se contentaient (déjà énorme pour l’époque) de chercher des références de texte dans les fichiers des sites. C’est-à-dire le nom du fichier d’une page, qui terminait l’URL (« l’adresse » d’une page).

Pendant ce temps Wandex se mettait en place, le premier moteur de recherche à se mettre à l’indexation : reconnaître via l’architecture des sites et par le nom des pages de quels sujets ils traitent. C’est un catalogage, comme un thesaurus. Mais il utilisait le premier « web bot », Wanderer.

Puis en 1994 vient la petite révolution : Webcrawler, qui a commencé à indexer tout le contenu d’une page et pas seulement son titre (le nom du fichier de la page). La même année se lançait Yahoo! qui tenait une sorte d’annuaire des sites, mis à jour « à la main » par des opérateurs humains. La société a fini par faire payer l’inclusion dans son annuaire.

Je ne vais pas vous faire l’historique au complet, d’excellents articles existent déjà sur le sujet (comme celui-ci chez agence-referencement). L’important est de retenir qu’avant 1998, les moteurs de recherches n’étaient quasiment « que » des annuaires. Google a commencé, à son lancement, à prendre une autre approche : ne plus seulement cataloguer, mais classer. Le « Page rank » comme on l’appelle. Les algorithmes comptaient le nombre d’apparitions des mots recherchés dans les pages du site et combien de liens externes (provenant d’autres sites) pointaient sur les pages. Ceci permettait de déterminer si le site était considéré par d’autres internautes et créateurs de sites comme fiable et pertinent. Le ranking était né. Littéralement le classement.

Je vous conseille d’ailleurs d’aller voir cette excellente vidéo de Un créatif sur Youtube au sujet de Yahoo et ses déboires. Je vous conseille d’ailleurs également de regarder ses autres vidéos et, tant qu’à faire, vous abonner à sa chaine qui parle de marketing et communication en général. Vous allez voir, ce ne sera pas du temps perdu.

Le fonctionnement des moteurs de recherche

Vous vous souvenez de Webcrawler, deux paragraphes plus haut ? Le référencement va se servir de cette technologie, bien plus perfectionnée. Des systèmes automatiques (« bot ») qui vont explorer tous les éléments d’une page et d’un site web, suivre tous les liens, lire toutes les données. On appelle cela des « crawlers » de l’anglais, qui veut dire initialement « rampeurs », plutôt utilisé pour parler des insectes, ou des araignées. Ce sont donc littéralement de petites araignées qui naviguent sur la fameuse « toile » : the Web.

Lorsqu’une demande d’indexation est faite pour un site, les moteurs de recherche vont lancer leurs « web spider », leurs crawlers, pour l’explorer de fond en comble. Il va commencer par lire le titre de votre page et les métadonnées que vous y ajoutez, puis à explorer de haut en bas votre page, suivre tous les liens, lire toutes les balises de titre, etc., etc. Il va établir un plan complet de votre site.

Il va ensuite transmettre ces données aux algorithmes du moteur de recherche dont il dépend, qui vont déterminer si votre contenu semble ou non pertinent (grâce au cocon sémantique et aux liens) selon certains sujets ou questions, appelées « requêtes ». Tout cela dans le but de classifier les pages selon ce qu’il estime être le sujet de votre contenu. Les algorithmes vont ensuite estimer, selon telle ou telle requête (question que pourrait se poser un internaute par exemple) si votre contenu ou votre site y répond correctement ou non. Ils vérifient si l’ensemble est assez complet, si votre site semble être une source sûre.

Ne pensez pas qu’un bot va venir une fois, repartir et ne jamais revenir. Les crawlers ne s’arrêtent jamais, ils vont et reviennent, regardent si du contenu n’a pas changé, ils vont vérifier que les liens sont toujours bons (d’où l’importance d’éviter les liens morts).

Enfin, les crawlers vont vérifier que votre site est suffisamment rapide, qu’il fonctionne correctement sur mobile et tablette, qu’il n’y a pas d’éléments trop petits à lire… il va se demander, selon une check-list prédéfinie, si votre site est agréable et facile à naviguer. Le bot n’a que faire de vous : son objectif est de fournir des résultats pertinents et agréables à compulser pour les utilisateurs des moteurs de recherche.

Tous ces facteurs vont faire la différence entre un site qui va être correctement indexé et référencé et un site oubliable, mal optimisé, « pas cher ». Pour plus d’information sur les tarifs des sites internet, j’ai réalisé un article sur le sujet.

L’important en SEO, ce sont les mots-clés ?

Les mots-clés ont leur importance, bien entendu. Mais l’époque où ils étaient absolument le nerf de la guerre est révolue. Les algorithmes ont évolué, les intelligences artificielles d’analyse sont de plus en plus poussées.

Lorsque les mots-clés étaient d’une importance capitale, les plus filous en ont profité. Ils gavaient leurs pages de mots-clés très recherchés alors que leur contenu n’avait aucun rapport avec le sujet. Tout y passait, actualités du moment, personnalité phare de l’époque, pornographie. Une guerre du ranking.

Mais les ingénieurs derrière les moteurs de recherche s’en sont bien évidemment rendu compte. Leur objectif était de fournir les résultats les plus pertinents possibles, ils ne pouvaient plus se contenter des mots-clés pour trier le bon grain de l’ivraie. Il fallait pousser les algos plus loin : la recherche sémantique. La mise à jour BERT de Google (fin 2019) l’a démontré, et c’est la direction que souhaite prendre Google : plus besoin de mots clés, c’est le contenu et la compréhension du sens des textes qui va primer.

Consultez cet article de Google (en anglais) pour en apprendre plus

Aujourd’hui, abuser des mots-clés dans le but de « tricher » sur votre SEO va au contraire faire du mal à votre référencement. On appelle cela du « keyword stuffing », bourrage de mots-clés en français. Les moteurs de recherche vont considérer que vous n’êtes pas une source fiable et vous faire descendre dans les tréfonds des résultats de recherche. Les algorithmes sont très, très performants.

Leur but dorénavant est d’analyser votre page : vos balises html, les attributs « alt » et légendes de vos images, des liens qui mènent à votre page et vers quelles autres pages vous pointez. Ils examinent votre texte pour essayer de déterminer eux-mêmes (et pas seulement via vos mots-clés) de quoi parle votre article, votre page, votre site. Les « intelligences artificielles » derrière les crawlers vont analyser le champ sémantique de votre texte pour s’assurer que vous parlez bien du bon sujet.

Les mots-clés (ou Keywords en anglais) vont tout de même améliorer le référencement : ils aident les algorithmes à mieux cerner votre contenu, ils vont pouvoir donner des alternatives (synonymes), bref, aider votre référencement. Mais se baser uniquement sur eux serait une erreur et ils seront de moins en moins utile à mesure que Google va évoluer.

Je veux être premier sur Google !

Combien de fois des créateurs de site ou référenceurs ont entendu cette phrase ! Il n’est clairement pas impossible d’être premier résultat sur Google pour « des petits sites », mais sur certaines requêtes.

Par exemple : comme vous l’imaginez, je ne suis pas « un gros site », pas un géant, je suis un freelance en communication qui aime le web. Mais si je tape sur « chargé de communication freelance à bordeaux » j’oscille entre la 1ere et la 2e page -peut varier selon votre localisation géographique, et devrait surtout s’améliorer dans les prochains mois-. Si vous tapez « financer site Internet », je suis le premier ou second résultat (sauf pour le « snippet », petit extrait tout en haut, mais j’y travaille 😉 ) Il s’agit de l’article que j’ai rédigé pour vous aider à trouver les financements pour lancer votre structure, par exemple trouver les fonds pour faire réaliser votre site Internet. Et j’ai atteint cette position sans débourser un centime en google adwords ou annonces.

Par contre si vous tapez « créateur de site Internet », vous imaginez bien que suis relégué loin, loin, très très loin. Et c’est bien normal. La différence ? La précision de la requête. Il est tout à fait possible pour n’importe quel site d’être le résultat n°1 sur Google sur certaines requêtes précises.

Le tout est de déterminer quelles sont les requêtes très spécifiques que vous voulez cibler, en vous mettant dans la peau de ce que votre cible va chercher, et en vous aidant des suggestions de Google. Plus vous viserez une « niche », ce qui fait réellement votre spécificité, plus « facilement » vous serez correctement classé sur Google, tout simplement faute de concurrence sérieuse ou bien optimisée.

Backlink, external link, internal link : le netlinking

Comme je l’ai écrit plus haut, les moteurs de recherche vont tenter de déterminer si votre site est digne de confiance, fiable, reconnu comme source d’information pertinente. Une partie de la décision sur ce sujet vient du linking.

Backlink

Point très important : combien de sites renvoient vers le vôtre ? Mieux, combien de sites fiables renvoient vers le vôtre ?

Imaginez que vous cherchiez un bon restaurant, vous allez vous fier à ce que vous disent vos amis, aux avis sur Internet ou à des articles qui classent les meilleurs restos de votre ville. Les moteurs de recherche font la même chose.

Plus il sera détecté de liens pointant vers votre site, votre article, à partir de sites eux-mêmes considérés comme fiables, plus un moteur de recherche considérera que vous êtes une source sûre. Mieux il vous classera. Donc plus vous êtes pertinent dans votre contenu, plus il sera intéressant, plus facilement il sera cité par d’autres créateurs de contenu, partagé sur les réseaux, etc. mieux il sera référencé.

Attention toutefois ! Ne cherchez pas à faire du backlink pour faire du backlink. Il faut que les liens qui mènent sur votre site aient une bonne raison d’exister, soient pertinents et logiques. Tenter de forcer du ces liens de manière « artificielle » est une bonne façon de fâcher google.

Si vous cherchez des informations plus précises sur le sujet, je vous recommande l’article sur le backlink du site semji.

Vous pouvez également estimer vos backlinks et à quel point google peut vous considérer comme « digne de confiance » grâce à l’outil de ahref d’authority checker

External link

C’est l’inverse : vers quels autres sites pointez-vous ? Si l’un de vos liens envoie vers un site peu fiable, qui n’a par exemple pas de certificat SLL (chiffrage des données, j’y reviendrai dans un futur article). S’il est considéré comme potentiellement frauduleux ou autre, un moteur de recherche va commencer à se méfier de votre site. Donc moins vous mettre en avant.

Note : il est très important de prévenir les bots que le lien pointe vers un autre site que le vôtre, c’est un code à rajouter dans la balise html, voici un petit article sur le sujet sur le site du journal du net. Inutile cependant de cliquer si vous n’avez pas des bases de html.

Par exemple, sur le premier lien de cet article, sur l’histoire des moteurs de recherche, j’ai ajouté un « nofollow » au lien pour dire aux bots de ne pas le suivre. Pourquoi ? Parce que le site en question n’a pas de certificat SSL, pointer vers lui pourrait peut-être me porter préjudice.

N’oubliez jamais que ce qui est pour vous un external link est un backlink pour le site vers lequel vous pointez. Si son ou ses administrateurs se rendent compte qu’il y a du trafic en provenance de votre blog par exemple, ils pourraient bien vous contacter. Ou simplement trouver votre contenu pertinent et eux-mêmes vous citer, vous créant plus de backlink.

Comme pour tant de chose, c’est à faire avec modération : s’il y a trop de liens sortants sur votre page cela peut vous porter préjudice. Pire, Google pourrait considérer que vous ne servez qu’à faire du backlink pour d’autres site, donc vous considérer comme non pertinent et non fiable. Essayez de rester sous la barre des 50 liens sortants sur une seule page et cela ne devrait pas poser de problème (google parle même de rester sous les 100). Et assurez-vous que ces liens soient utiles à votre utilisateur.

Internal Link

Ce sont littéralement les liens internes à votre site, qui renvoient de page en page, d’article en article. Ils ont plusieurs intérêts : l’un d’entre eux bien sûr est de faciliter la navigation sur votre site par vos internautes. En leur donnant l’occasion d’aller plus loin sur tel ou tel sujet, de changer de page pour aller voir quelque chose qui a piqué leur curiosité, vous allez les retenir plus longtemps sur votre site et mieux les informer. Le temps que passe un internaute sur votre site et le nombre de pages qu’il visite ont un impact positif sur votre référencement.

Pour les crawlers, cela est également important : si vos liens internes sont bien faits, qu’ils sont placés à des endroits pertinents par rapport au sujet et au niveau hiérarchique de vos pages, cela va les aider à comprendre votre structure, votre offre, les informations que vous donnez.

N’oubliez pas qu’un crawler est un robot, il va aller de haut en bas sur votre page, suivre le premier lien qui trouve, l’indexer, y suivre les liens, tout indexer, puis revenir à son point de départ pour continuer. Plus vous lui donnez un chemin cohérent à suivre, mieux il pourra faire une « carte » de votre site. Attention, cela ne veut pas dire mettre des liens internes partout. Il faut les mettre partout où cela a une pertinence logique pour lier des pages ou des articles entre eux.

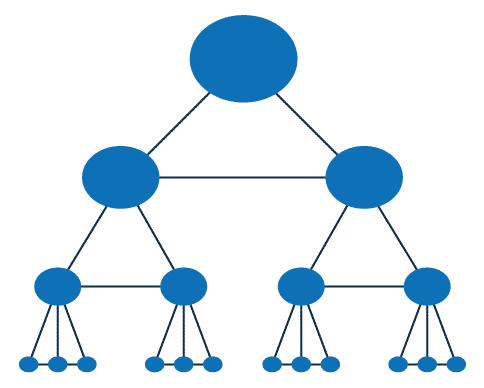

L’une des méthodes régulièrement utilisée pour l’architecture d’un site et la mise en place de ses liens internes est appelée le « silo ». Une passerelle entre les niveaux de même importance. Une forme de suite logique. Peut-être que ce schéma vous rendra cela plus clair.

Les méthodes pour être bien référencé

Le plus simple ? Faites appel à un référenceur. Le SEO est en perpétuelle évolution, en apprendre toutes les ficelles est un travail à part entière.

Alors effectivement, cela implique un certain budget, si vous ne pouvez pas vous le permettre, il va falloir vous former, ce sera long, parsemé d’embûches et d’erreurs. À vous de voir si le temps investi vaut plus la chandelle que le devis d’une personne dont c’est le métier.

Quelques principes de base cependant vont vous aider ; vous devez déjà les avoir saisis à la lecture de cet article :

- Des titres de pages clairs et explicites, pas trop longs

- Une bonne architecture de site

- Des balises html bien utilisées

- Une bonne gestion des liens (tant dans leur placement que dans les balises utilisées)

- Des textes visant à répondre à des questionnements spécifiques

- Une richesse linguistique et sémantique permettant aux bots d’identifier clairement votre sujet

- Suffisamment de texte pour bien vous faire comprendre par les internautes comme par les bots

- Un site clair avec du contenu agréable à lire et pertinent pour donner envie aux utilisateurs d’y passer du temps

- Un site responsive qui fonctionne aussi bien sur ordinateur que mobile

- Un site sécurisé (certificat SSL) et plutôt rapide

- Du contenu régulier

Pourquoi je ne suis pas encore remonté sur Google ? Ça prend du temps ?

Oui ! Ne vous attendez pas à voir trop vite les résultats de vos efforts (ça peut être décourageant, je sais). Même en respectant toutes les « bonnes pratiques » du SEO, un article peut stagner longtemps. Mais plus il sera consulté, plus les internautes resteront dessus, plus il sera partagé, plus les moteurs de recherches le considéreront comme qualitatif. De là c’est un effet boule de neige.

Un blog, même bien conçu, ne doit pas s’attendre à avoir un flux de centaines ou d’un millier de visiteurs avant plusieurs mois, voire plus d’une année si vous souhaitez atteindre plusieurs milliers d’utilisateurs mensuels. Le SEO, ce n’est pas QUE la manière dont est conçu votre site, ses articles ou son architecture. Sinon tout serait immédiat. C’est aussi le comportement de vos utilisateurs qui va aider les moteurs de recherche à se rendre compte que ce que vous expliquez dans votre page/article vaut le coup d’être mis en avant.

Vos meilleurs référenceurs sont finalement vos utilisateurs, d’où le dernier point :

CIK : Content is King

« Le contenu est roi »

Vous pouvez bourrer votre site de mots-clés, de liens et de contenu optimisé. Cela aidera au début, mais fera rapidement plus de mal que de bien. Si votre objectif final est d’être bien placé sur Google, vous prenez le problème à l’envers : votre objectif est de satisfaire vos utilisateurs. Si c’est le cas, vous verrez peu à peu votre notoriété grandir sur les moteurs de recherche.

Donc plutôt que d’essayer d’absolument avoir la petite pastille verte de votre plugin de référencement : lisez-vous, relisez-vous, faites-vous lire. Est-ce que vous estimez que votre contenu apporte une réelle plus-value ? Est-ce qu’il apprend des choses ? Est-ce que si vous tombiez sur cet article de plus de 2500 mots, vous le liriez jusqu’au bout ? Est-ce que vous auriez envie d’en parler à vos amis ou collègues ou de le partager ?

Si c’est le cas et que vous avez au moins respecté les pratiques de base de SEO, le trafic arrivera peu à peu. Si vous écrivez sur un sujet qui vous passionne, soyez passionnant(e). Si vous rédigez sur votre spécialité métier, soyez précis(e) et instructif(ve), que votre lectrice ou lecteur s’en sorte grandi(e) dans la compréhension du sujet que vous abordez. Si vous souhaitez faire fleurir votre business, créez du contenu pertinent sur les questions que pourraient se poser vos clients. Écrivez ce que vous aimeriez lire et ce que vous pensez que votre public aimerait compulser. Soyez créateur de contenu.

Et si l’écriture ce n’est vraiment pas votre truc, n’oubliez pas que votre chargé de communication freelance préféré est aussi un rédacteur, faites appel à lui 😉

Oui… moi, je parlais de moi.

2 réponses

Your Post is very well and I am very impress on your website keep again same posting. >>>>>>>>>

Civil Engineering Jobs In Canada

Normally I don’t read article on blogs, however I wish to say that this write-up very compelled me to try and do it! Your ԝriting taste has been surprise >>>>

jobs jobs in dubai